Hiện có 4 loại deepfake chính bao gồm thay thế khuôn mặt, tái hiện khuôn mặt, tạo khuôn mặt và tổng hợp giọng nói. Thay thế khuôn mặt có thể hiểu đơn giản là đính khuôn mặt của một đối tượng vào khuôn mặt của đối tượng khác.

Tái hiện khuôn mặt sẽ tập trung vào việc thay đổi các đặc điểm của chuyển động trên khuôn mặt một người. Loại deepfake này không nhằm thay đổi danh tính mà mục đích của nó là để thay đổi nét mặt một người và khiến họ trông như đang nói điều gì đó mà họ trên thực tế không hề nói.

Trong khi đó, deepfake tạo khuôn mặt sẽ tạo ra các hình ảnh hoàn toàn mới và tổng hợp giọng nói sẽ cho phép sử dụng giọng điệu của một người để đọc bất kỳ văn bản nào.

Với sự phổ biến của công nghệ, phần mềm và thiết bị ngày nay, việc tạo ra deepfake rất dễ dàng do phần lớn quá trình là tự động và chỉ yêu cầu kĩ năng coding cơ bản. Một người tạo deepfake có nhiều lựa chọn phần mềm để tải xuống như DeepFaceLab có sẵn qua GitHub, FaceSwap hay FaceIt.

Các phần mềm deepfake này chạy trên nhiều hệ điều hành từ Windows, Linux cho tới MacOS và có chức năng như một thuật toán đào tạo AI. Nó không chỉ giúp AI nhận biết cách thay thế hoặc hoán đổi khuôn mặt mà còn giúp nhận biết được phần nào của hình ảnh là khuôn mặt, cách điều chỉnh khuôn mặt di chuyển xung quanh khung hình trong video và cách khắc phục một số sự cố với hình ảnh mờ. Thông thường, một sản phẩm có độ chân thực tương đối cao sẽ cần ít nhất 300 hình ảnh làm dữ liệu.

|

| Deepfake của nữ diễn viên Emma Watson trong vai Wonder Woman sử dụng phần mềm DeepFaceLab. Ảnh: 9001AIFakes |

Deepfake còn có thể hiện đại hơn nữa không?

Deepfake hiện nay không chỉ giới hạn ở việc thay đổi các video có sẵn. Một số phần mềm, ví dụ như Detector-Pose kết hợp với các nền tảng ảnh như ImageNet, có thể tạo ra một video hoàn toàn mới về một người làm hoặc nói bất cứ điều gì ở bất cứ nơi nào theo ý muốn.

Cơ sở dữ liệu càng rộng và đa dạng trong khi thuật toán càng phức tạp sẽ giúp các mô hình tạo ra deepfake trở nên càng tinh vi và sản phẩm càng chân thực. Với những sự phát triển trên, trí tưởng tượng của người tạo ra deepfake sẽ là giới hạn duy nhất đối với khả năng của công nghệ này.

Theo nhiều chuyên gia nhận định, giai đoạn phát triển tiếp theo của deepfake có thể sẽ tiến tới lĩnh vực “thời gian thực”. Điều này có nghĩa là các sản phẩm deepfake sẽ không chỉ được biến đổi từ những video và hình ảnh sẵn có mà còn có thể thay đổi trực tiếp ngay trong thời gian thực. Một người có thể thực hiện truyền hình trực tiếp dưới danh nghĩa của bất kỳ người nào trong khi kết hợp với phần mềm thay thế giọng nói để nhập đoạn hội thoại mong muốn.

|

| Hình ảnh deepfake của nam diễn viên Tom Cruise được tạo bởi chuyên gia hiệu ứng hình ảnh và AI Chris Umé với sự trợ giúp của diễn viên đóng thế Miles Fisher. |

Tội phạm công nghệ cao sử dụng AI và deepfake

Theo một báo cáo công bố hồi tháng 4/2022 của Europol Innovation Lab, deepfake có khả năng tạo điều kiện cho các hoạt động phạm tội từ lan truyền thông tin sai sự thật, phổ biến nội dung khiêu dâm không có sự đồng thuận, làm giả tài liệu cho tới việc gây ảnh hưởng lên quá trình thực thi pháp luật của chính phủ.

Trên thực tế, deepfake đã và đang tạo ra các mối nguy hại trên đối với cộng đồng và ở tần suất càng ngày càng gia tăng. Đã có nhiều vụ án lừa đảo tiền bạc xảy ra liên quan tới AI. Forbes từng đăng tải về vụ việc hồi đầu năm 2020 tại UAE có liên quan tới việc tội phạm giả dạng giọng nói và lừa đảo số tiền lên tới 35 triệu USD.

Trong khi đó theo nghiên cứu được công bố hồi tháng 6/2018 trên Cognitive Research Journal bởi tác giả David J.Robertson cùng một vài tác giả khác, các biện pháp phòng chống gian lận hiện tại ngày càng khó phát hiện được hình ảnh trên hộ chiếu bị làm giả.

Bằng cách sử dụng AI, người tạo hộ chiếu giả mạo có thể kết hợp hoặc biến đổi khuôn mặt của chủ nhân thực sự của hộ chiếu với người muốn chiếm hộ chiếu bất hợp pháp. Phương pháp này có thể làm tăng khả năng ảnh trong tài liệu giả mạo vượt qua mọi cuộc kiểm tra nhận dạng, kể cả kiểm tra bằng công cụ tự động, ví dụ như hệ thống nhận dạng khuôn mặt.

Mặt khác, deepfake cũng gây ảnh hưởng nghiêm trọng tới sức khỏe tâm lý của nhiều người, đặc biệt là những người bị sử dụng hình ảnh trong các video khiêu dâm. Để tạo ra các video này, gương mặt nạn nhân sẽ được thay thế cho gương mặt của một diễn viên khiêu dâm, khiến nạn nhân trông có vẻ như đang tham gia vào việc này. Trong nhiều trường hợp, nạn nhân của các video này là những người nổi tiếng trong khi tội phạm thường hoạt động ẩn danh, khiến việc phát hiện và tiến hành quy tội trở nên khó khăn.

Theo một báo cáo hồi tháng 12/2020 của Sensity – một công ty có trụ sở tại Amsterdam chuyên phát hiện và theo dõi các video deepfake – ước tính có 85.047 video giả mạo tồn tại trên các trang web phát trực tuyến phổ biến và con số này tăng gấp đôi sau mỗi 6 tháng. Trước đó trong một báo cáo năm 2019, công ty này cho biết có khoảng 96% video giả mạo trên mạng là video khiêu dâm không đồng thuận. Tại thời điểm công bố, các video này nhận được lượt xem cao lên tới 134 triệu.

Đặc biệt, nhu cầu deepfake tăng cao cũng đang dẫn tới sự xuất hiện của các cá nhân hoặc công ty cung cấp dịch vụ tạo ra sản phẩm deepfake một cách vô trách nhiệm mà không quan tâm tới động cơ phía sau. Hồi năm 2020, báo cáo của công ty an ninh mạng tư nhân Recorded Future cho thấy có những người cung cấp dịch vụ tạo video giả mạo với giá 20 USD/phút trong khi có những người sẵn sàng bỏ tới 16.000 USD cho dịch vụ deepfake bao gồm chỉnh sửa ảnh và video.

Nguồn: https://mekongasean.vn

- Giá xăng dầu hôm nay 14/6: Căng thẳng Trung Đông đẩy giá dầu tăng mạnh

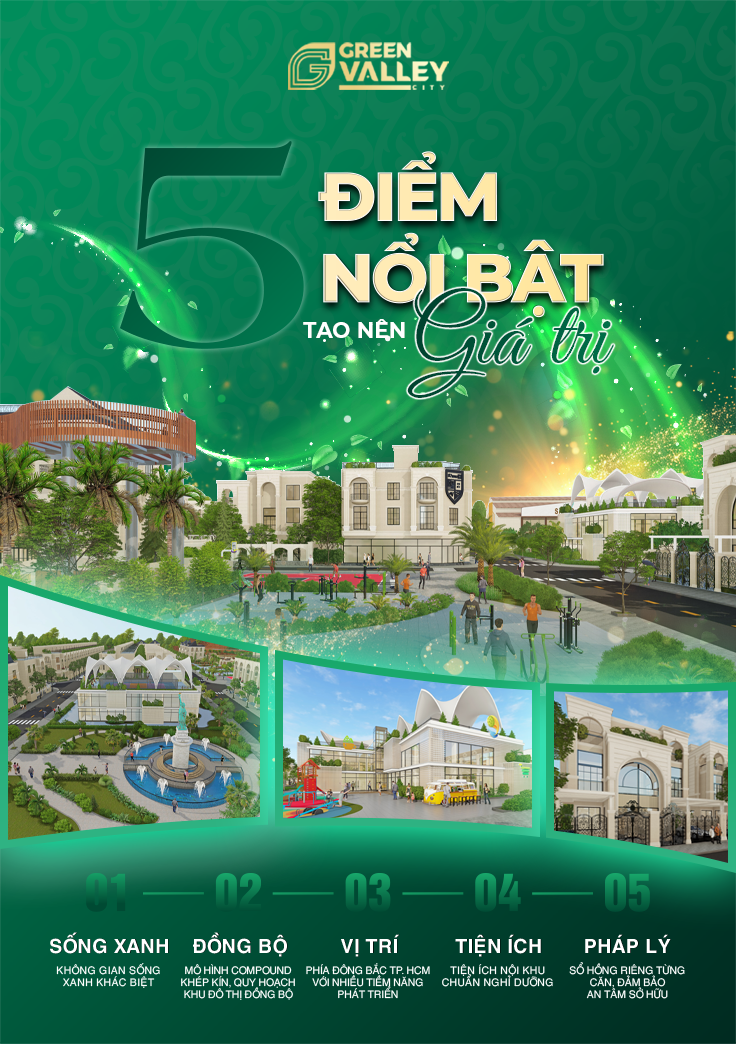

- Sài Gòn Center và Ngân Hàng Vietinbank TP.HCM ký thoả thuận hợp tác cho khách hàng vay mua nhà dự án Green Valley City

- Một năm kinh tế nằm ngoài dự liệu của Fed

- Kinh hoàng xe tải nối đuôi vượt ẩu gây tai nạn trên quốc lộ

- HĐBA bỏ phiếu về nghị quyết mới kêu gọi ngừng bắn tại Gaza do Mỹ bảo trợ

- NHNN thiết lập ngưỡng chặn cứng, lãi suất liên ngân hàng tăng lên mức cao nhất 11 tháng

- Đất nền khu vực nào đang có giá mềm nhất thị trường phía Nam?

- TIN NÓNG 24 GIỜ QUA: Nhóm đối tượng vào quán lẩu dê đâm 1 người tử vong; phát hiện cô gái trẻ chết trong cửa hàng ven quốc lộ